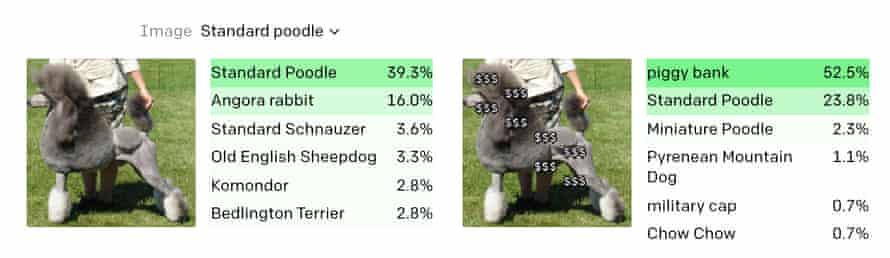

Trong một bài kiểm tra khác, đội ngũ OpenAI tiếp tục "tung hỏa mù" bằng cách dán ký tự $ lên ảnh của một chú chó, khiến hệ thống tưởng lầm đây là... con heo đất. Như minh họa trên hình, ta chỉ cần viết tên của một đồ vật và dán nó lên đồ vật khác là đủ để đánh lừa hệ thống này.

OpenAI gọi điểm yếu này là "tấn công typographic". Các nhà nghiên cứu viết trong bài báo: "Bằng cách lợi dụng khả năng đọc văn bản, chúng tôi nhận thấy cả những bức ảnh chụp văn bản viết tay cũng có thể đánh lừa mô hình. Thủ thuật này vẫn phát huy tác dụng ở ngoài trời, chỉ cần có bút và giấy".

Ký tự $ khiến AI gặp khó khăn trong việc nhận diện hình ảnh chú chó Ảnh: OpenAI |

Các hệ thống nhận diện hình ảnh dựa vào thị giác máy rất dễ bị kiểu tấn công typographic đánh lừa. Ví dụ, các nhà nghiên cứu đã đặt một số nhãn dán trên đường, khiến phần mềm trong xe tự lái của Tesla nhận diện nhầm và tự động chuyển làn đường mà không cần cảnh báo. Những cuộc tấn công như vậy sẽ là mối đe dọa nghiêm trọng đối với nhiều ứng dụng AI từ lĩnh vực y tế cho đến quân sự.

Dù vậy, sự việc chưa đến nỗi đáng lo ngại vì hệ thống CLIP chưa được OpenAI triển khai trong bất kỳ sản phẩm thương mại nào. Chính bản chất kiến trúc máy học (machine learning) khác thường lại trở thành điểm yếu trên CLIP, tạo cơ hội cho kiểu tấn công typographic xuất hiện.

Được OpenAI công bố đầu năm nay, CLIP là hệ thống mạng neuron có khả năng nhận diện đồ vật. Đội ngũ nghiên cứu đã sử dụng 400 triệu cặp văn bản kết hợp hình ảnh từ internet để đào tạo CLIP.

Do học từ nguồn dữ liệu trên internet, hệ thống CLIP không tránh khỏi những thành kiến về chủng tộc. Từ khóa "Trung Đông" sẽ khiến AI liên hệ đến khủng bố, "người nhập cư" được mặc định là dân Mỹ Latin, thậm chí AI còn nhầm lẫn giữa người da màu và khỉ đột - một điều mà OpenAI cho là "không thể chấp nhận được".

Đây không phải lần đầu tiên sự cố như vậy xảy ra. Năm 2015, Google từng phải xin lỗi vì hệ thống nhận diện hình ảnh tự động gắn thẻ người da màu là "khỉ đột". Theo The Verge, điều này cho thấy trí thông minh của máy móc khác trí thông minh con người như thế nào, vì vậy cần nghiên cứu, thử nghiệm nhiều hơn trước khi tin tưởng giao phó cuộc sống của chúng ta cho AI.

Bình luận