Theo CNN, đây cũng là phương pháp tạo ra thêm lo ngại trước thềm bầu cử tổng thống Mỹ năm 2020. Video giả mạo lan rộng là mối lo của các nhà lãnh đạo chính trị và cộng đồng tình báo Mỹ. Họ quan ngại rằng video giả có thể được dùng để lừa cử tri.

Các nhà nghiên cứu thuộc Trung tâm AI Samsung ở Moscow và Viện Khoa học và công nghệ Skolkovo giải thích về phương pháp mới trong bài viết học thuật công bố trên ấn bản arXiv tuần này. Họ cho biết mình có thể khiến một hoặc vài tấm ảnh người chuyển động bằng cách đào tạo cho hệ thống AI dựa trên bộ dữ liệu video, trong đó có nhiều video của những người nổi tiếng.

Hệ thống AI khi được đào tạo theo cách này có thể “học” các điểm chính trên khuôn mặt người. Sau đó, nó kết hợp sự quen thuộc đó với một hoặc nhiều tấm ảnh của một người để đưa ra video kiểu gương mặt đang nói chuyện.

Đoạn video mà giới nghiên cứu đăng tải lên YouTube cho thấy nhiều ví dụ về mức độ thuyết phục của phương pháp tạo video giả mới. Phiên bản động ấn tượng của nhà vật lý Albert Einstein và diễn viên Marilyn Monroe được tạo ra từ nhiều hình ảnh mang tính biểu tượng của họ. Tuy nhiên, phương pháp vẫn còn cần được cải thiện. Đơn cử trong video của Einstein, tóc của ông không di chuyển với cái đầu, còn diễn viên Monroe thì không có nốt ruồi ở má.

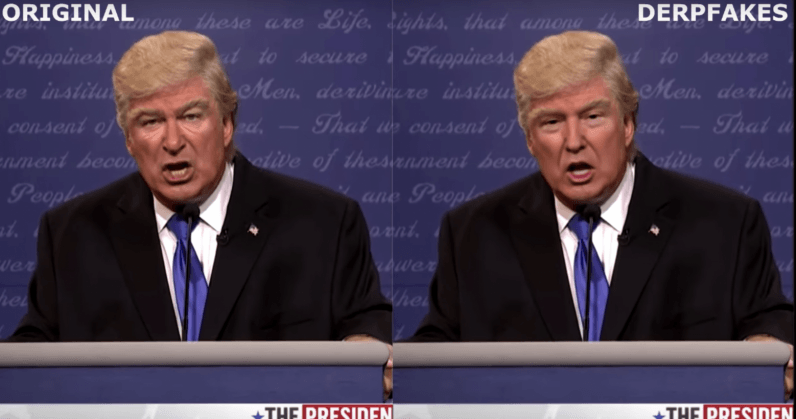

Phương pháp này khá giống với deepfake, sự kết hợp giữa công nghệ học sâu và giả mạo để tạo ra video, âm thanh giả bằng công nghệ AI tiên tiến và tương đối dễ tiếp cận. Các nhà nghiên cứu lần này sử dụng kỹ thuật AI tương tự như công nghệ đứng sau deepfake. Đây là phương pháp học máy có tên GANs.

Điểm khác là deepfake tạo ra sản phẩm giả mạo từ video của một người khác hành động theo cách mà giới nghiên cứu muốn người trong video giả thực hiện. Ví dụ, video của diễn viên hài Jordan Peele được dùng để “mớm chữ” cho video giả mạo với sự xuất hiện của cựu Tổng thống Barack Obama.

Công việc của các nhà nghiên cứu vẫn ở giai đoạn đầu. Hệ thống AI chỉ được “dạy” để tạo ra video với hình ảnh đầu, cổ và một phần vai của một người. Nhược điểm của phương pháp tạo video giả này là nếu nó không nhận được đủ dữ liệu, chất lượng của sản phẩm giả được tổng hợp sẽ hạn chế. Video được tạo ra với nhiều hình ảnh hơn thì có chất lượng và độ “thật” cao hơn. Chẳng hạn video được tạo ra từ tám và 32 hình ảnh trông ngày càng thực hơn so với video được tạo ra chỉ với một hình ảnh.

Bình luận (0)